![]() 前沿资讯

1750070145更新

前沿资讯

1750070145更新

![]() 0

0

6月16日,谷歌在社交平台表示祝贺《深入理解卷积神经网络》获得2025年Longuet-Higgins奖。Longuet-Higgins奖由IEEE计算机协会模式分析与机器智能(PAMI)技术委员会在每年CVPR(计算机视觉与模式识别会议)上颁发。该奖项旨在表彰十年前在CVPR上发表、并对计算机视觉研究产生了重大且持久影响的论文。

2014年9月,谷歌的研究团队介绍了一种名为Inception的深度卷积神经网络架构。该架构在当年的ImageNet大规模视觉识别挑战赛(ILSVRC14)中大放异彩,不仅在图像分类和检测任务上创造了新的技术标杆,还为深度学习的发展开辟了新的方向。

Inception架构的核心设计理念是在不显著增加计算资源消耗的前提下,提升神经网络的深度和宽度。传统提升神经网络性能的直接方法是增加层数和神经元数量,但这会导致参数数量呈指数级增长,不仅容易过拟合,还会极大增加计算负担。

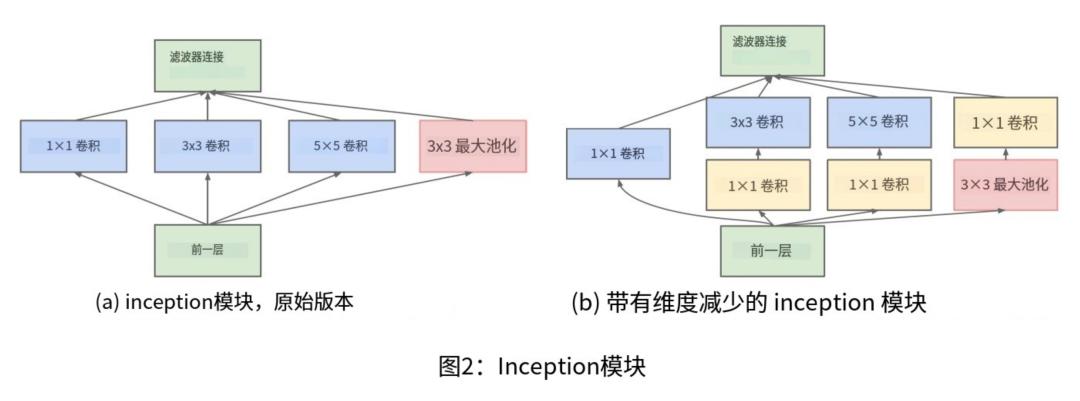

谷歌的研究团队另辟蹊径,从神经科学的Hebbian原理和多尺度处理的直觉中获得灵感,提出了一种全新的网络模块设计。这种被称为“Inception模块”的结构,通过多分支卷积操作,实现了对计算资源的高效利用。模块中同时包含1×1、3×3和5×5等不同尺度的卷积核,以及最大池化路径,能够从不同尺度提取图像特征,再将这些特征融合,形成更丰富的表示。

为了解决大尺寸卷积核带来的计算量问题,研究团队创新性地引入了1×1卷积作为降维模块。在进行3×3或5×5卷积之前,先用1×1卷积对输入特征图进行降维,这样不仅减少了计算量,还增加了网络的非线性表达能力,可谓一举两得。

基于Inception架构,谷歌团队开发了参赛模型GoogLeNet。GoogLeNet拥有22层参数层,总参数数量约为680万,相比2012年冠军模型AlexNet的6000万参数,减少了整整12倍,但性能却有显著提升。

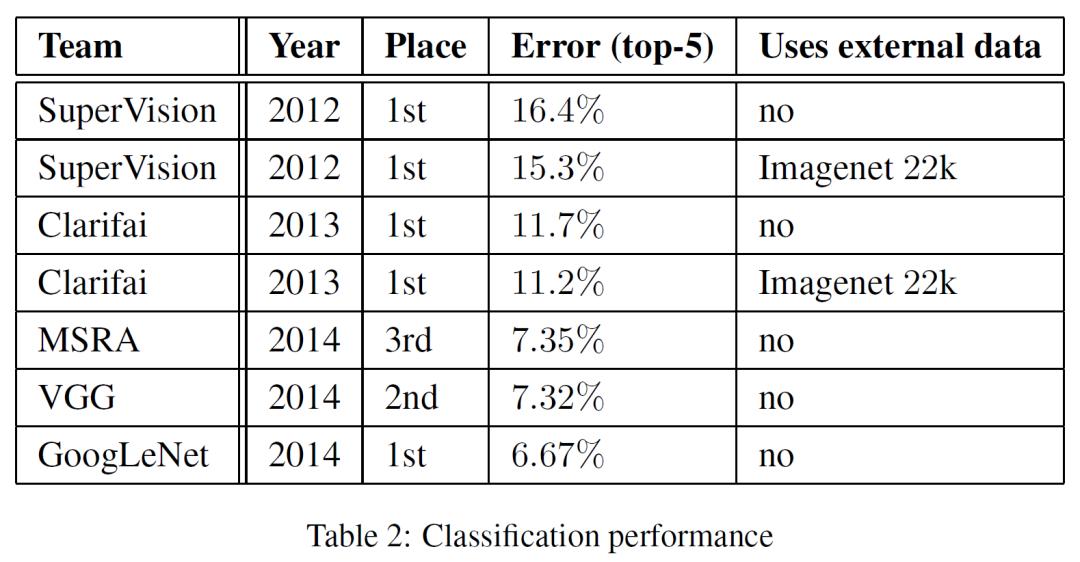

在ILSVRC14的分类任务中,GoogLeNetTop-5错误率仅为6.67%,相比2013年冠军模型的11.2%有大幅下降。另外,虽然其他顶级参赛团队也取得了不错的成绩,但GoogLeNet在参数数量和计算效率上具有明显优势。

研究团队还通过添加辅助分类器来解决深度网络中的梯度传播问题。这些辅助分类器连接到中间层,在训练过程中提供额外的梯度信号,帮助浅层网络学习更具判别性的特征,同时也起到了正则化的作用。

Inception架构的提出,标志着神经网络架构设计从简单的“增加深度和宽度”转向更注重“高效利用计算资源”的新阶段。这种“分而治之”的多尺度处理思路,不仅在ImageNet竞赛中取得了成功,也为后续的深度学习研究提供了重要启示。

参考资料:https://arxiv.org/abs/1409.4842

豫公网安备41010702003375号

豫公网安备41010702003375号