![]() 前沿资讯

1753872203更新

前沿资讯

1753872203更新

![]() 0

0

在Y Combinator(YC)举办的创业峰会上,Anthropic联合创始人兼首席科学家Jared Kaplan(贾里德·卡普兰)发表了一场题为《扩展定律与通往人类水平AI之路》的深度演讲。Kaplan博士曾长期从事理论物理研究,后转向AI领域,凭借其独特的物理学视角,揭示了AI训练中的“规模定律”及其对智能提升的关键作用。

Kaplan介绍,现代大模型的训练主要分为两个阶段:预训练(Pre-training) 与 强化学习(Reinforcement Learning, RL)。预训练使模型学会预测文本中下一个词的概率,从而掌握语言结构与知识关联;而强化学习则通过人类或AI反馈,优化模型的“有用性、诚实性与无害性”行为。关键在于,这两个阶段均存在清晰可测的扩展定律,即模型性能随计算量、数据量与模型参数规模的增加而呈现可预测的、近乎线性的提升。

“我们意识到,AI的智能提升并非偶然,而是一条可系统性推进的路径,”Kaplan表示,“这给了我们极大的信心:只要持续投入计算资源,AI将不断变得更聪明。”

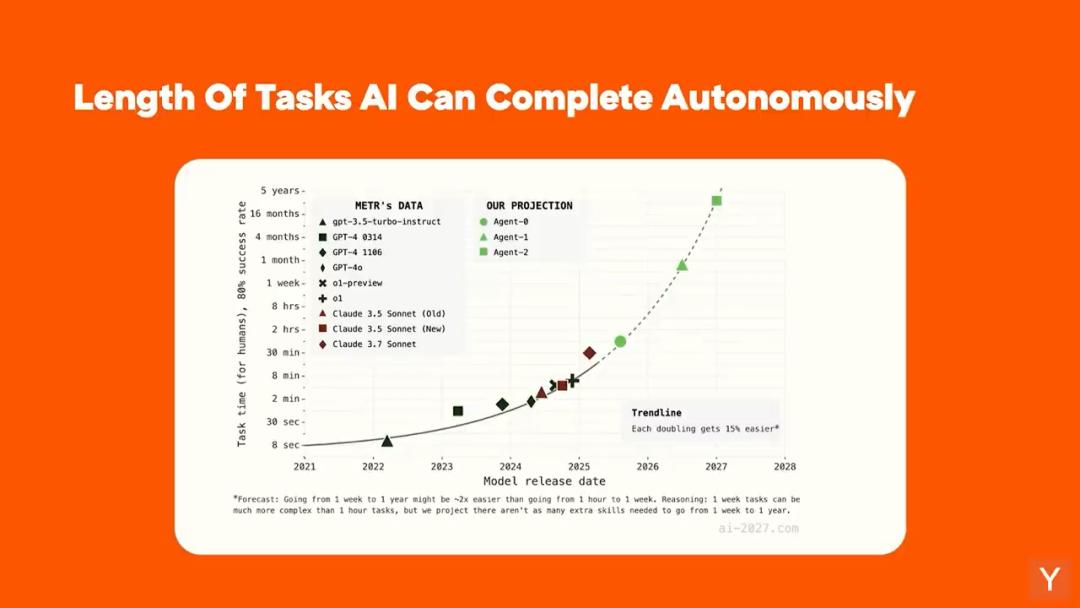

Kaplan提出,AI能力可从两个维度衡量:任务时间跨度(X轴)与模态灵活性(Y轴)。当前AI正沿着这两个轴快速进化。据研究机构Meter测算,AI能处理的任务时长每7个月翻一番。这意味着,从当前可处理如编写代码、撰写报告等的“小时级”任务,未来几年内或将逐步胜任“天、周、月甚至年”级别的复杂工作。

“我们正在走向一个临界点,”Kaplan预测,“未来AI或将能完成整个科研团队、企业部门甚至跨组织协作才能完成的任务。想象一下,AI系统在几天内完成理论物理界50年的思想演进。”

虽然扩展定律推动AI持续进步,Kaplan认为,要实现广泛意义上的“人类水平AI”,仍需突破三大瓶颈:

1. 组织知识(Organizational Knowledge):AI需具备“入职即上手”的能力,理解企业、政府等机构的内部语境与隐性规则,而非从零开始。

2. 记忆(Memory):在执行长期任务时,AI需能主动记录、存储与调用过程信息。Anthropic已在Claude 4中引入“记忆文件”功能,以突破上下文窗口限制。

3. 监督能力(Oversight):当前强化学习依赖明确反馈,但许多高阶任务,如讲笑话、写诗、判断研究价值等需要“模糊监督”。未来需发展能生成精细奖励信号的AI系统,以训练更富“品味”与“判断力”的模型。

面对AI的快速迭代,Kaplan向在场创业者提出三点建议:

● 构建“尚不完美”的产品:AI模型更新极快,今日“不够聪明”的模型明日即可胜任。应勇于在技术边界上实验。

● 用AI加速AI集成:当前最大瓶颈并非技术本身,而是AI在企业、科研等场景的落地速度。应利用AI自动化集成流程。

● 寻找下一个“编码级”爆发点:编程是AI落地的首个大规模场景,下一个可能是金融分析、法律文书、生物医学研究等“高技能、高数据交互”领域。

展望未来,Kaplan观察到,AI应用正从“Copilot”向“全工作流替代”演进。越来越多YC创业公司正销售“端到端自动化”解决方案,而非辅助工具。“未来,人类的角色将更像‘管理者’,负责设定目标与最终把关,”他总结道,“而AI将成为能承接越来越长周期、高复杂度任务的‘数字同事’。我们正走向一个AI与人类深度协作,共同释放创造力的新时代。”

参考资料:https://www.youtube.com/watch?v=p8Jx4qvDoSo

豫公网安备41010702003375号

豫公网安备41010702003375号