![]() 前沿资讯

1754986900更新

前沿资讯

1754986900更新

![]() 0

0

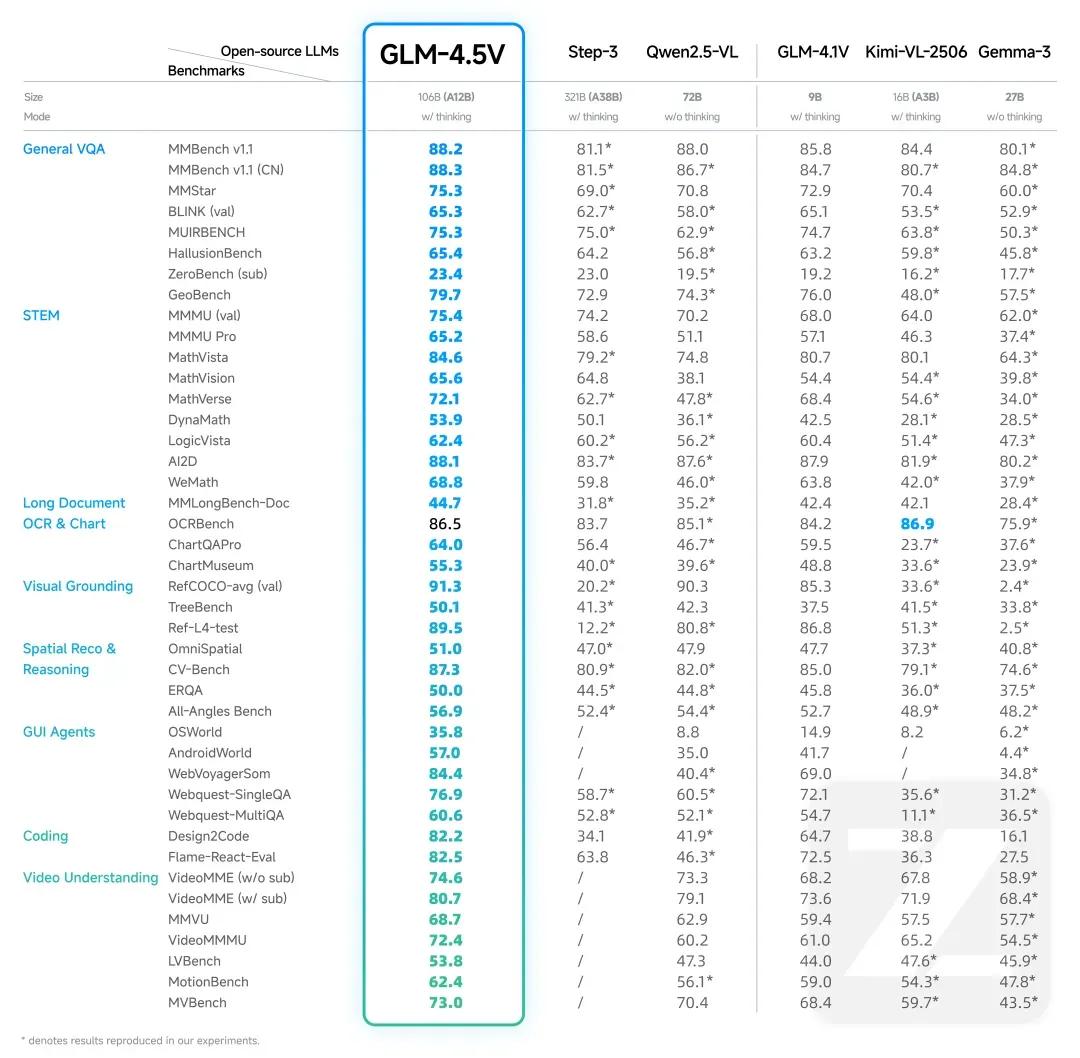

智谱AI宣布,全球100B级效果最佳的开源视觉-语言推理模型GLM-4.5V正式面向公众开源,并同步上线智谱开放平台(BigModel.cn)。该模型总参数106B、激活参数12B,在41项公开多模态评测中达到同级别开源模型的SOTA表现。

今年7月,智谱AI开源的GLM-4.1V-9B-Thinking以“小体积、大能量”迅速登顶Hugging Face Trending,累计下载量超13万次。时隔一月,GLM-4.5V将参数规模推升至百亿级,同时引入“思考模式”开关,用户可在快速响应与深度推理间自由切换,兼顾效率与精度。

GLM-4.5V基于新一代旗舰文本基座GLM-4.5-Air,延续“Thinking”技术路线,在图像、视频、文档理解及GUI Agent等41项权威榜单中均取得SOTA(State-of-the-Art)成绩。其能力覆盖:

● 图像推理:复杂多图分析、位置识别

● 视频理解:长视频分镜、事件识别

● GUI任务:屏幕读取、图标定位、桌面操作辅助

● 图表与长文档解析:研报分析、信息提取

● 精准Grounding:坐标级视觉元素定位

GLM-4.5V采用视觉编码器+MLP适配器+语言解码器三组件架构,支持64K多模态长上下文,首次将三维卷积与3D旋转位置编码(3D-RoPE)引入百亿级VLM,显著增强对高分辨率、极端宽高比及视频内容的理解与稳健性。训练采用“预训练—监督微调—强化学习”三阶段策略,结合RLVR与RLHF,在STEM、多模态定位及Agent任务上实现全面优化。

真实场景验证:在“图寻游戏”全球积分赛中,GLM-4.5V仅用时16小时即击败99%的人类选手,7天后排名升至全球第66位,充分验证其复杂视觉推理与地点识别能力。

智谱AI表示,GLM-4.5V的开源与API化旨在与全球开发者共建多模态生态,把过去仅存在于科幻电影中的场景带进现实。“我们相信,开放的技术社区将激发更多创意,加速通用人工智能的到来。”

即日起,用户可登录z.ai或智谱清言APP/网页版,上传图片、视频并开启“推理模式”,即刻体验GLM-4.5V的多模态魅力。为降低体验门槛,智谱AI同步开源桌面助手应用GLM-4.5V Demo App,支持实时截屏、录屏及多轮对话,可一键完成代码辅助、视频解析、游戏答疑、文档解读等任务。

开源地址:

GitHub: https://github.com/zai-org/GLM-V

Hugging Face: https://huggingface.co/collections/zai-org/glm-45v-68999032ddf8ecf7dcdbc102

ModelScope: https://modelscope.cn/collections/GLM-45V-8b471c8f97154e

API 价格:

输入2元/百万 tokens,输出6元/百万 tokens,响应速度达60-80 tokens/s

豫公网安备41010702003375号

豫公网安备41010702003375号