![]() 前沿资讯

1767344713更新

前沿资讯

1767344713更新

![]() 0

0

导读:一个编程模型,参数不到竞争对手的十分之一,却在多个权威基准测试中拿下SOTA成绩。这背后的团队不来自科技巨头,而是国内一家量化对冲基金。

AI编程模型圈又炸了。

这次不是OpenAI,不是Anthropic,而是一家来自中国的Quest Research团队,背后站着量化对冲基金巨头九坤(UBIQUANT)。他们刚发布的开源代码模型IQuest-Coder,参数规模只有40B,却在多项关键指标上超越了Claude Sonnet 4.5和GPT-5.1这些"庞然大物"。

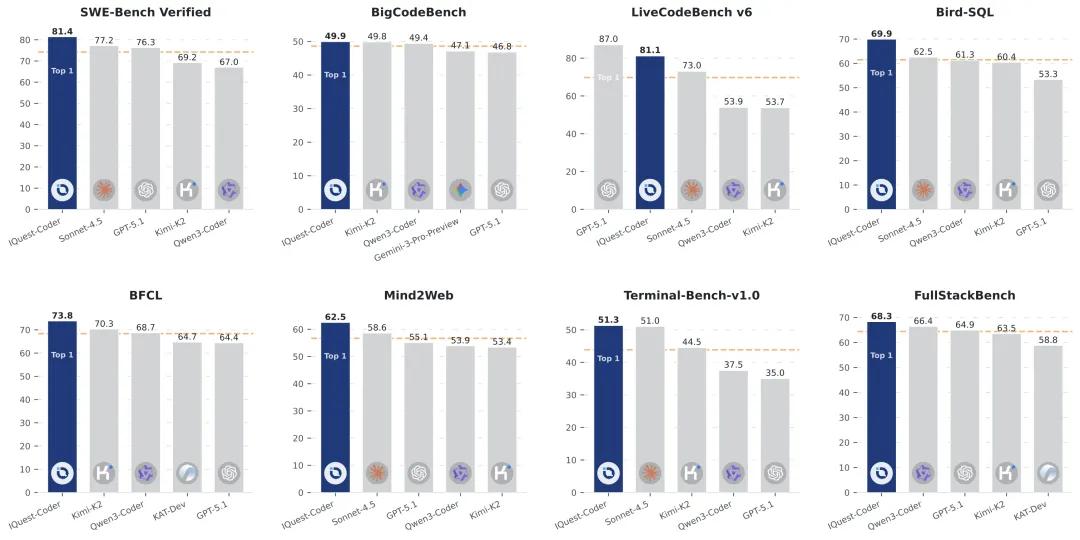

听起来有点玄乎?但数据摆在那儿。IQuest-Coder在三个硬核基准测试上的成绩相当亮眼:

- SWE-Bench Verified:81.4%

- BigCodeBench:49.9%

- LiveCodeBench v6:81.1%

要知道,这个模型只有40B参数,而它对标的Claude Sonnet 4.5和GPT-5.1,参数规模至少是它的十倍以上。 更难得的是,它在代理式软件工程、竞技编程和复杂工具使用这几个维度上全面开花:不是偏科生,而是六边形战士。

IQuest-Coder的策略很有意思,它采用"双轨制"后训练方案,推出了两个方向的变体:

Thinking模型,走的是推理增强路线。它用基于强化学习的推理驱动方法,专啃硬骨头,复杂问题分解、步骤化思考,输出虽然长,但逻辑链完整,适合需要"想清楚再动手"的场景。

Instruct模型,则追求效率和通用性。它针对日常编程任务和指令遵循做了优化,响应快、资源占用低,适合当成"编程小助手"日常调用。

现在的代码模型,普遍面临长上下文这关不好过的问题。很多模型需要额外的扩展技术才能支持长文本,处理起来麻烦,效果还不稳定。

IQuest-Coder直接在架构层面解决了这个问题:全系列原生支持128K tokens上下文,不需要任何额外的Scaling技巧。这对于分析大型代码库、跨文件理解项目结构这类任务,相当实用。

另外,团队还捣鼓出了一个Loop变体。它在推理过程中引入了循环机制,用共享参数的方式在两次迭代间复用计算能力,愣是在保持性能的同时把部署成本压了下来。对于资源有限但又想要高性能的团队来说,这个设计很有吸引力。

目前,IQuest-Coder系列已经在Hugging Face上开源,包括7B、14B、40B三个规格,以及对应的Base、Instruct、Thinking和Loop版本。开发者可以直接下载使用,也可以通过vLLM部署成OpenAI兼容的API服务。

AI代码模型这个赛道,OpenAI和Anthropic固然是标杆,但并不意味着没有其他玩家的空间。Quest Research这次证明了一点:找准定位、差异化打法,小团队也能撬动大格局。

项目地址:https://github.com/IQuestLab/IQuest-Coder-V1

豫公网安备41010702003375号

豫公网安备41010702003375号