![]() 前沿资讯

1767687163更新

前沿资讯

1767687163更新

![]() 0

0

【导读】AMD 这次在 CES 上真正想传达的信息,并不是“又发了几块新 GPU”,而是它终于把 AI 加速器这件事,从“单卡性能竞争”推进到了“按应用场景精细拆分的基础设施级产品线”。

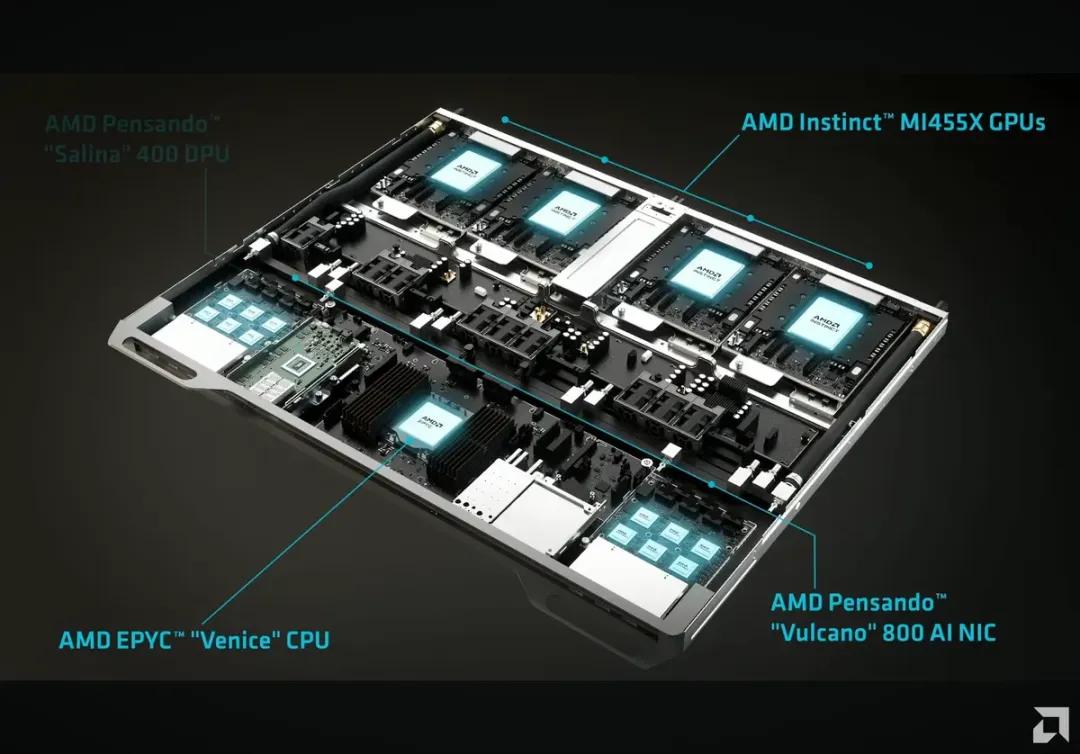

在CES 2026上,AMD 公布了完整的 MI400 系列 AI 加速器家族,覆盖了从高性能计算,到企业私有部署,再到超大规模 AI 数据中心。同时,Helios 的机架级 AI 架构方案,将 CPU、GPU 和内存带宽整合为一个整体系统来交付。

如果只看发布会表面,你会看到一堆型号:Instinct MI430X、MI440X、MI455X,以及一个叫 Helios 的机架级系统。但真正重要的是,AMD 正在明确告诉市场:未来的 AI 计算,不再存在“一颗 GPU 打天下”,而是需要为不同精度、不同部署形态、不同客户类型量身定做。

MI400 系列不再是同一架构下的“性能高低款”,而是按计算精度被刻意拆分成不同产品方向。MI455X 和 MI440X 被明确优化为低精度 AI 工作负载,重点面向 FP4、FP8、BF16 这类当前主流的训练与推理场景。而 MI430X 则保留了完整的 FP32、FP64 能力,服务于高精度 AI 和传统 HPC 超算任务。

这种拆分并不是简单的产品细分,而是一种工程层面的取舍。通过针对精度“裁剪”计算逻辑,AMD 可以减少无用电路,从而在功耗、面积和成本上获得更高的硅效率。这背后反映的是大模型时代,大多数 AI 任务并不需要全精度计算,但少数关键场景仍然离不开它。

另外,需要注意的是,本次推出的机架级 AI 架构方案 Helios,并不是为所有客户准备的“通用方案”,而是一套只适合新一代 AI 数据中心的极端配置。它集成了 72 颗 MI455X,加起来拥有 31TB 的 HBM4 显存和 1.4PB/s 的带宽,功耗和散热需求极其苛刻,意味着只有在电力、液冷条件成熟的超大规模数据中心,才有落地空间。这更像是 AMD 给头部云厂商和国家级算力中心准备的“旗舰模板”。

相比之下,MI440X 所驱动的企业级 AI 平台,反而更贴近现实市场。它刻意保持与现有数据中心在供电和散热上的兼容性,目标是让企业在不大改基础设施的前提下,把 AI 训练、微调和推理真正搬进本地机房。这也是 AMD 在 NVIDIA 之外,试图撬动企业级 AI 市场的重要切入口。

从影响来看,这套产品组合清晰地指向三类人群:超大规模云厂商、有主权算力需求的政府与科研机构,以及希望私有化部署 AI 的传统企业。短期内,我们可能不会立刻看到 MI400 系列大规模出货,但可以预期的是,AMD 已经为 2026 年之后的 AI 计算,提前铺好了从单机到机架、从低精度到高精度的完整路径。

如果说过去 AMD 还在追赶 NVIDIA 的节奏,那么这一次,它开始用自己的方式定义“AI 基础设施应该如何被拆分和交付”。

参考资料:https://www.tomshardware.com/tech-industry/artificial-intelligence/

豫公网安备41010702003375号

豫公网安备41010702003375号