![]() 工具推荐

1768906666更新

工具推荐

1768906666更新

![]() 0

0

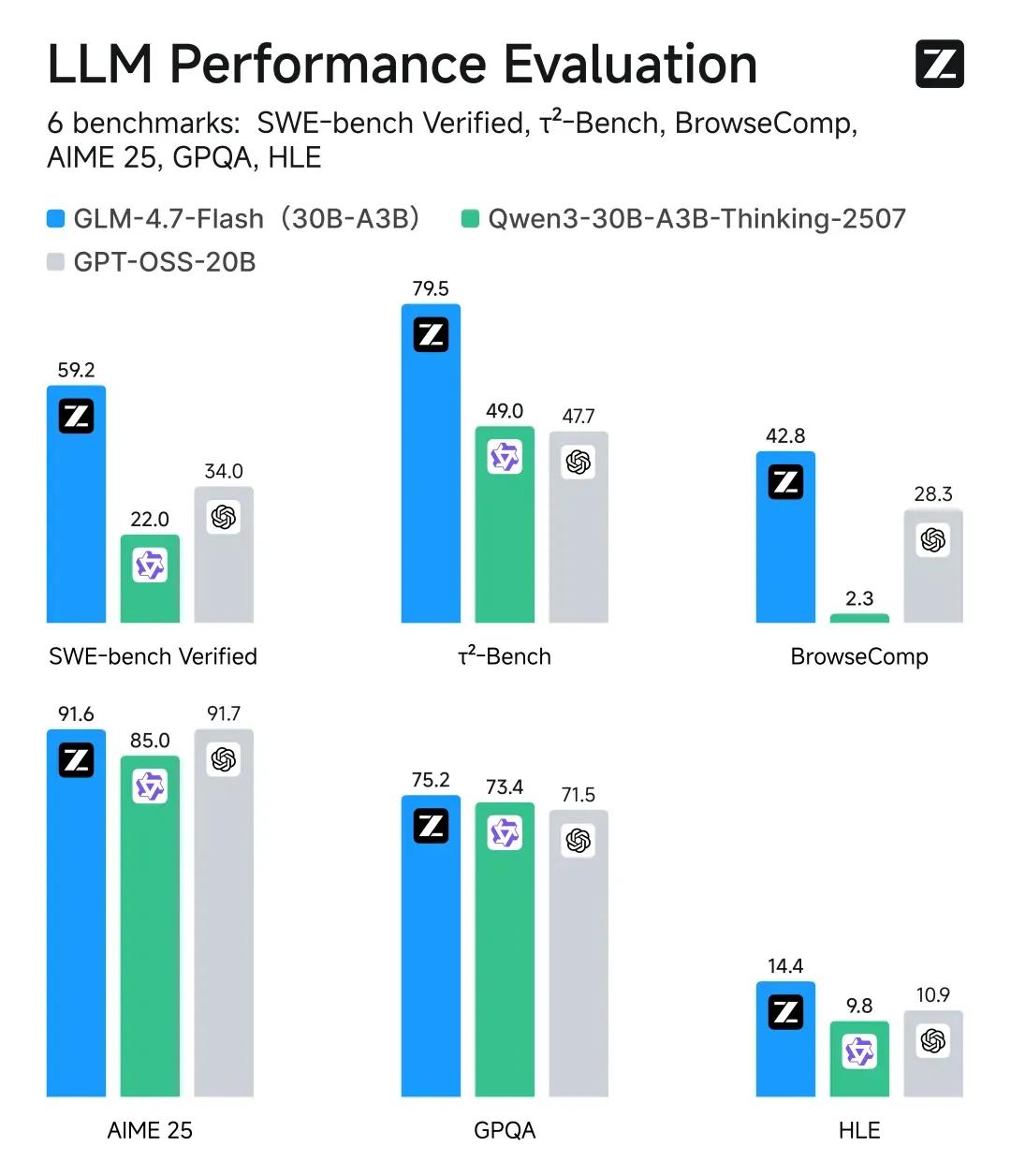

导读:智谱AI正式发布并开源了GLM-4.7-Flash模型。这款混合思考模型在SWE-bench Verified、τ²-Bench等基准测试中取得开源SOTA分数,综合表现超越gpt-oss-20b、Qwen3-30B-A3B-Thinking-2507等同级别模型。

GLM-4.7-Flash 是一款专为轻量化部署打造的混合思考模型,以30B总参数量、3B激活参数的架构,实现了性能与效率的完美平衡,被誉为同级别SOTA模型。

即日起,GLM-4.7-Flash将全面替代GLM-4.5-Flash,在智谱开放平台BigModel.cn正式上线,并继续提供免费调用服务。

核心性能数据一览:

- 总参数量:30B

- 激活参数量:3B

- 上下文长度:200K tokens

- 许可证:MIT(完全开源商用)

在SWE-bench Verified、τ²-Bench等国际权威基准测试中,GLM-4.7-Flash的综合表现超越gpt-oss-20b、Qwen3-30B-A3B-Thinking-2507,在相同和近似尺寸模型系列中取得了开源SOTA分数。

在智谱官方的内部编程实测中,模型能够从目标描述出发,自主完成需求理解、方案拆解与多技术栈整合,真正实现"任务完成"而非单点代码生成,展现了作为"编程助手"的卓越能力。

编程能力亮点:

- 前后端联动任务轻松驾驭,可直接生成结构完整、可运行的代码框架

- 深度思考过程清晰可见,涵盖分析、策略制定、代码起草、代码完善、约束审查五大步骤

- 具备自我审查纠错能力,生成代码正确可用

- 复杂场景中显著减少人工拼装与反复调试时间

除编程场景外,智谱官方还推荐用户在中文写作、翻译、长文本处理、情感/角色扮演等通用场景中体验GLM-4.7-Flash,模型同样表现优异。

API调用方式:

| 渠道 | 地址 |

|---|---|

| 体验中心 | https://bigmodel.cn/trialcenter/modeltrial/text?modelCode=glm-4.7-flash |

| 使用指南 | https://docs.bigmodel.cn/cn/guide/models/free/glm-4.7-flash |

| 接口文档 | https://docs.bigmodel.cn/api-reference/模型-api/对话补全 |

本地部署:

| 平台 | 地址 |

|---|---|

| Hugging Face | https://huggingface.co/zai-org/GLM-4.7-Flash |

| 魔搭社区 | https://modelscope.cn/models/ZhipuAI/GLM-4.7-Flash |

GLM-4.5-Flash将于2026年1月30日正式下线,后续相关请求将会自动路由至GLM-4.7-Flash,确保服务连续性不受影响。

参考资料:https://mp.weixin.qq.com/s/PZY_pyf0wBLYKFMNQedoxg

豫公网安备41010702003375号

豫公网安备41010702003375号